LM Studio’da Model Quantization (Kuantizasyon) Nedir? RAM Dostu Yapay Zeka Kullanımı

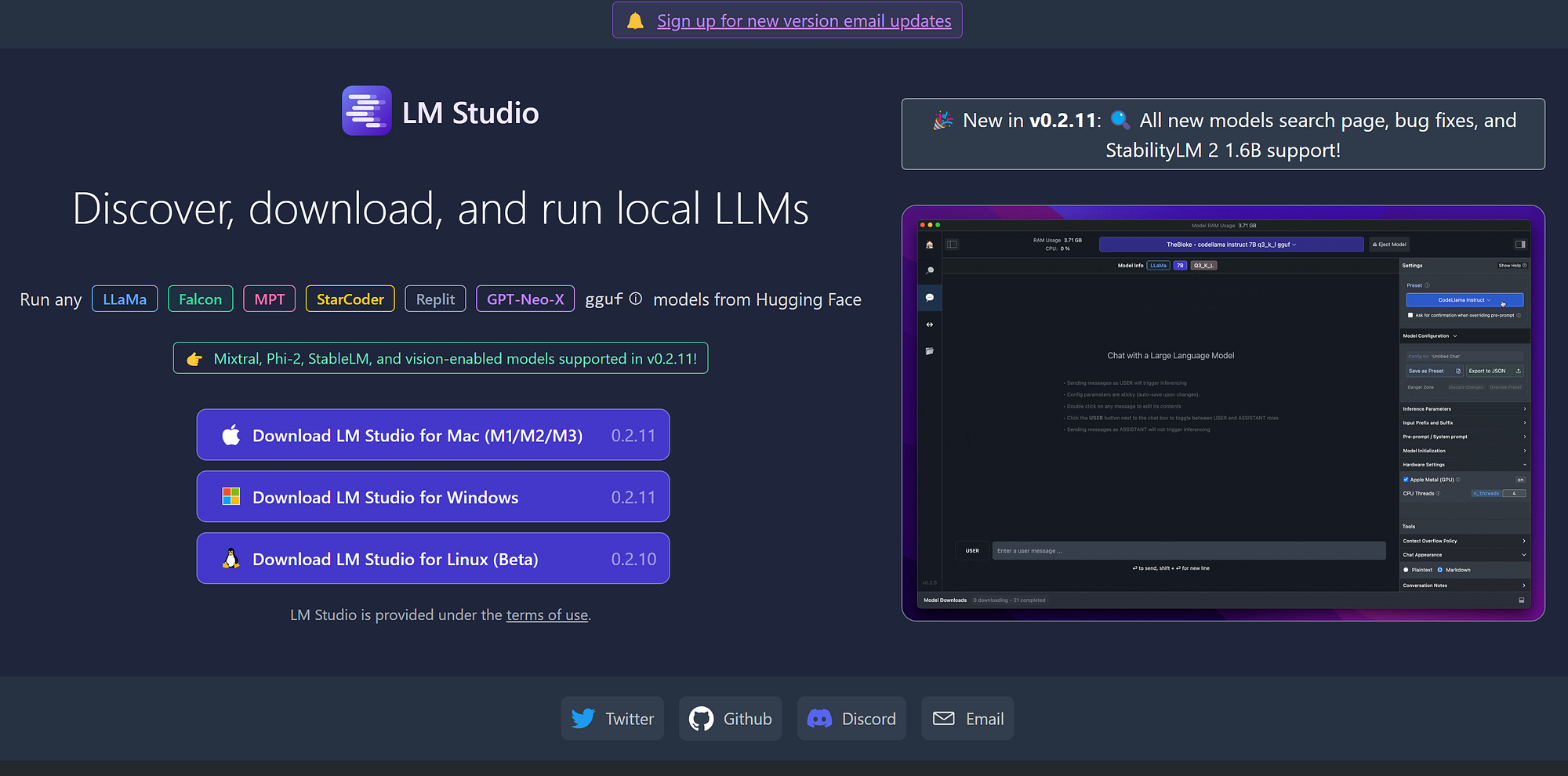

Yapay zeka modellerini bilgisayarda yerel olarak çalıştırmak son yıllarda oldukça popüler hale geldi. Özellikle LM Studio gibi araçlar sayesinde kullanıcılar, internet bağlantısına ihtiyaç duymadan kendi bilgisayarlarında büyük dil modellerini çalıştırabiliyor. Ancak burada en çok karşılaşılan konulardan biri RAM ve VRAM kullanımıdır.

Bir modeli indirirken genellikle Q4, Q5, Q6, Q8, FP16, GGUF veya Q4_K_M gibi ifadeler görürsünüz. Bu ifadeler ilk bakışta karmaşık görünebilir. Aslında bunların büyük bölümü modelin kuantizasyon seviyesiyle ilgilidir.

Peki LM Studio’da model quantization yani kuantizasyon nedir? Hangi modeli seçmek gerekir? RAM’i az olan bilgisayarlarda hangi kuantizasyon seviyesi daha mantıklıdır? Bu rehberde konuyu sade ve anlaşılır şekilde ele alıyoruz.

Model Quantization Nedir?

Model quantization, bir yapay zeka modelinin daha az bellek kullanacak şekilde küçültülmesi işlemidir. Büyük dil modelleri milyonlarca hatta milyarlarca parametreden oluşur. Bu parametreler modelin öğrendiği bilgileri temsil eder.

Normalde bu parametreler yüksek hassasiyetli sayısal formatlarda saklanır. Bu da modelin daha fazla disk alanı, RAM ve ekran kartı belleği kullanmasına neden olur. Kuantizasyon işlemi ise bu sayısal değerleri daha düşük bit seviyelerine indirerek modelin boyutunu küçültür.

Basit bir örnekle anlatmak gerekirse:

Yüksek çözünürlüklü bir fotoğrafı daha düşük dosya boyutuna sıkıştırmak gibi düşünebilirsiniz. Fotoğraf hâlâ görünür ve kullanılabilir durumdadır, ancak dosya boyutu azalır. Kuantizasyon da yapay zeka modeli için benzer bir mantıkla çalışır.

LM Studio’da Kuantizasyon Ne İşe Yarar?

LM Studio, bilgisayarınıza yapay zeka modelleri indirip çalıştırmanızı sağlayan kullanışlı bir yerel yapay zeka aracıdır. Bu modeller genellikle farklı kuantizasyon seçenekleriyle sunulur.

Kuantizasyonun temel amacı şudur:

- Modelin daha az RAM kullanmasını sağlamak

- Daha düşük donanımlarda büyük modelleri çalıştırabilmek

- Diskte daha az yer kaplamak

- Yerel yapay zeka kullanımını daha erişilebilir hale getirmek

- CPU veya GPU üzerinde modeli daha pratik çalıştırmak

Örneğin 16 GB RAM’e sahip bir bilgisayarda çok büyük ve tam hassasiyetli bir modeli çalıştırmak zor olabilir. Ancak aynı modelin Q4 veya Q5 gibi kuantize edilmiş sürümü daha rahat çalışabilir.

GGUF Formatı Nedir?

LM Studio’da sıkça karşılaşılan dosya formatlarından biri GGUF’tur. GGUF, yerel büyük dil modellerinde kullanılan popüler model formatlarından biridir. Özellikle llama.cpp tabanlı çalışan sistemlerde yaygın olarak kullanılır.

GGUF modeller, farklı kuantizasyon seviyeleriyle sunulabilir. Bu nedenle model indirirken şu tarz dosya adları görebilirsiniz:

- model-adı-Q4_K_M.gguf

- model-adı-Q5_K_M.gguf

- model-adı-Q6_K.gguf

- model-adı-Q8_0.gguf

Buradaki Q harfi genellikle quantization yani kuantizasyon seviyesini ifade eder. Yanındaki sayı ise modelin yaklaşık bit seviyesini gösterir.

Q4, Q5, Q6 ve Q8 Ne Anlama Gelir?

LM Studio’da model seçerken en çok karşınıza çıkan ifadelerden bazıları Q4, Q5, Q6 ve Q8’dir. Bunlar modelin ne kadar sıkıştırıldığını gösterir.

Q4 Modeller

Q4 modeller, genellikle düşük RAM’e sahip kullanıcılar için en uygun seçeneklerden biridir. Model boyutu daha küçüktür ve daha az bellek kullanır.

Avantajları:

- Daha az RAM kullanır

- Daha küçük dosya boyutuna sahiptir

- Orta seviye bilgisayarlarda daha kolay çalışır

- Yerel yapay zekaya başlamak için idealdir

Dezavantajları:

- Yanıt kalitesi daha yüksek kuantizasyonlara göre biraz düşebilir

- Karmaşık görevlerde daha fazla hata yapabilir

- Uzun ve detaylı analizlerde kalite farkı hissedilebilir

Q4 modeller, özellikle 8 GB veya 16 GB RAM’e sahip sistemlerde denenebilir.

Q5 Modeller

Q5 modeller, kalite ve RAM kullanımı arasında daha dengeli bir seçenektir. Q4’e göre biraz daha fazla bellek kullanır ancak cevap kalitesi genellikle daha iyidir.

Avantajları:

- Q4’e göre daha iyi yanıt kalitesi sunabilir

- Hâlâ RAM dostu sayılır

- Günlük kullanım için dengeli bir tercihtir

- Sohbet, yazı yazma, kod yardımı ve özetleme için uygundur

Dezavantajları:

- Q4’e göre daha fazla RAM kullanır

- Çok düşük donanımlarda zorlayıcı olabilir

Eğer bilgisayarınızda 16 GB veya üzeri RAM varsa Q5_K_M gibi modeller iyi bir başlangıç noktası olabilir.

Q6 Modeller

Q6 modeller, daha yüksek kalite isteyen kullanıcılar için uygundur. Q5’e göre daha fazla bellek kullanır ancak modelin orijinal performansına daha yakın sonuçlar verebilir.

Avantajları:

- Daha iyi doğruluk sağlayabilir

- Yaratıcı yazım, analiz ve kodlama gibi görevlerde daha başarılı olabilir

- Kalite kaybı daha düşüktür

Dezavantajları:

- Daha fazla RAM veya VRAM ister

- Eski bilgisayarlarda yavaş çalışabilir

- Dosya boyutu daha büyüktür

Q6 modeller genellikle güçlü işlemciye, yeterli RAM’e veya iyi bir ekran kartına sahip kullanıcılar için daha uygundur.

Q8 Modeller

Q8 modeller, kuantizasyon uygulanmış olsa da daha yüksek hassasiyetli seçenekler arasında yer alır. Kaliteye önem veren kullanıcılar için tercih edilebilir.

Avantajları:

- Daha yüksek yanıt kalitesi sunabilir

- Modelin orijinal davranışına daha yakın olabilir

- Teknik ve detaylı görevlerde daha iyi sonuç verebilir

Dezavantajları:

- RAM kullanımı yüksektir

- Dosya boyutu büyüktür

- Düşük sistemlerde çalıştırmak zor olabilir

Q8 modeller genellikle yüksek RAM’e ve güçlü donanıma sahip kullanıcılar için uygundur.

FP16 Nedir?

FP16, kuantize edilmemiş veya daha az sıkıştırılmış modellerde görülebilen bir formattır. FP16 modeller genellikle daha yüksek kalite sunar ancak çok daha fazla bellek kullanır.

Bu nedenle FP16 modelleri çalıştırmak için güçlü ekran kartı, yüksek VRAM ve yeterli RAM gerekebilir. Günlük kullanıcılar için çoğu zaman Q4, Q5 veya Q6 modeller daha mantıklı olur.

Q4_K_M Ne Demek?

LM Studio’da en çok görülen ifadelerden biri Q4_K_M olabilir. Bu ifade, modelin belirli bir kuantizasyon yöntemiyle sıkıştırıldığını gösterir.

Genel olarak şu şekilde düşünebilirsiniz:

- Q4: Yaklaşık 4-bit kuantizasyon seviyesini ifade eder.

- K: Daha gelişmiş kuantizasyon türlerinden birini temsil eder.

- M: Medium yani orta denge anlamında kullanılır.

Q4_K_M, çoğu kullanıcı için iyi bir başlangıç seçeneğidir. Çünkü hem dosya boyutu makuldür hem de kalite tamamen gözden çıkarılmış olmaz.

Q5_K_M Ne Demek?

Q5_K_M, Q4_K_M’e göre biraz daha yüksek kalite sunabilen bir kuantizasyon seçeneğidir. Daha fazla RAM kullanır ancak cevap kalitesi genellikle daha tatmin edici olabilir.

Eğer sisteminiz yeterliyse ve daha kaliteli yanıtlar almak istiyorsanız Q5_K_M iyi bir tercih olabilir.

RAM Dostu Yapay Zeka Kullanımı İçin Hangi Kuantizasyon Seçilmeli?

Kullanacağınız kuantizasyon seviyesi bilgisayarınızın donanımına göre değişir. Genel bir öneri yapmak gerekirse:

8 GB RAM:

Q3 veya Q4 seviyesindeki küçük modeller tercih edilebilir. 7B modellerin Q4 sürümleri denenebilir, ancak performans sistemden sisteme değişebilir.

16 GB RAM:

Q4_K_M ve Q5_K_M modeller günlük kullanım için uygundur. 7B ve bazı 8B modeller rahat çalışabilir.

32 GB RAM:

Q5, Q6 ve bazı daha büyük modeller denenebilir. 13B veya daha büyük modellerde daha iyi sonuç alınabilir.

64 GB RAM ve üzeri:

Q6, Q8 veya daha büyük modeller daha rahat kullanılabilir. Daha uzun bağlam penceresi ve daha kaliteli sonuçlar için güçlü bir sistem avantaj sağlar.

LM Studio’da Model Seçerken Nelere Dikkat Edilmeli?

LM Studio’da model indirirken sadece modelin adına bakmak yeterli değildir. Aşağıdaki kriterleri de değerlendirmek gerekir:

1. RAM ve VRAM Miktarı

Bilgisayarınızda ne kadar RAM olduğu en önemli faktörlerden biridir. Eğer ekran kartınız varsa VRAM miktarı da performansı doğrudan etkileyebilir.

Düşük RAM’e sahip sistemlerde Q4 modeller daha mantıklı olabilir. Daha güçlü sistemlerde Q5, Q6 veya Q8 denenebilir.

2. Model Parametre Sayısı

Model adlarında 3B, 7B, 8B, 13B, 14B, 32B gibi ifadeler görebilirsiniz. Buradaki B, milyar parametre anlamına gelir.

Örneğin:

- 7B: 7 milyar parametre

- 13B: 13 milyar parametre

- 32B: 32 milyar parametre

Parametre sayısı arttıkça modelin kapasitesi artabilir, ancak RAM ihtiyacı da yükselir.

3. Kullanım Amacı

Her kullanıcı aynı modeli seçmek zorunda değildir. Kullanım amacınıza göre seçim yapmak daha doğrudur.

Sohbet için:

Q4 veya Q5 modeller yeterli olabilir.

Kod yazımı için:

Q5 veya Q6 modeller daha iyi sonuç verebilir.

Uzun metin analizi için:

Daha yüksek RAM ve daha iyi kuantizasyon seviyesi gerekebilir.

Yaratıcı yazılar için:

Q5_K_M veya Q6 modeller dengeli sonuç verebilir.

4. Bağlam Penceresi

Bağlam penceresi, modelin aynı anda ne kadar metni hatırlayabildiğini gösterir. Daha uzun bağlam penceresi daha fazla bellek kullanabilir.

Bu nedenle RAM dostu kullanım istiyorsanız çok yüksek context ayarları yerine daha dengeli değerler tercih etmek daha mantıklıdır.

Kuantizasyon Kaliteyi Düşürür mü?

Evet, kuantizasyon bazı durumlarda model kalitesini düşürebilir. Ancak bu her zaman büyük bir kayıp anlamına gelmez.

Q4 gibi daha agresif kuantizasyonlarda model bazen daha kısa, daha yüzeysel veya daha hatalı yanıtlar verebilir. Q5 ve Q6 seviyelerinde ise kalite kaybı çoğu günlük kullanımda daha az hissedilir.

Burada önemli olan doğru dengeyi bulmaktır. En büyük modeli en düşük kuantizasyonla çalıştırmak her zaman en iyi sonuç anlamına gelmez. Bazen daha küçük ama daha kaliteli kuantizasyon seviyesine sahip bir model, daha iyi kullanıcı deneyimi sunabilir.

Küçük Model mi, Büyük Model mi?

Yerel yapay zeka kullanırken sık yapılan hatalardan biri her zaman en büyük modeli seçmeye çalışmaktır. Büyük modeller daha yetenekli olabilir, ancak donanımınız yeterli değilse çok yavaş çalışabilir.

Örneğin zayıf bir bilgisayarda büyük bir modeli Q3 veya Q4 olarak çalıştırmak yerine, daha küçük bir modeli Q5 veya Q6 seviyesinde kullanmak daha verimli olabilir.

Bu nedenle şu mantıkla ilerlemek daha sağlıklıdır:

Önce sisteminize uygun küçük veya orta boy bir model deneyin. Performans iyiyse daha yüksek parametreli veya daha yüksek kaliteli kuantizasyonlara geçin.

LM Studio’da RAM Kullanımını Azaltmak İçin İpuçları

LM Studio’da daha verimli kullanım için şu noktalara dikkat edebilirsiniz:

Daha Düşük Kuantizasyon Seçin

RAM’iniz azsa Q4_K_M gibi modeller iyi bir başlangıç olabilir. Bu modeller dosya boyutu ve bellek tüketimi açısından daha avantajlıdır.

Daha Küçük Parametreli Model Kullanın

13B veya 32B modeller yerine 7B ya da 8B modellerle başlamak daha mantıklı olabilir.

Context Değerini Çok Yükseltmeyin

Bağlam penceresini gereğinden fazla artırmak RAM kullanımını yükseltebilir. Günlük kullanımda orta seviyeli context ayarları daha dengeli sonuç verir.

Aynı Anda Çok Fazla Uygulama Açmayın

Yerel yapay zeka modelleri RAM’i yoğun kullanabilir. LM Studio kullanırken tarayıcıda çok fazla sekme, oyun, video düzenleme programı veya ağır uygulamalar açıksa performans düşebilir.

GPU Kullanımını Kontrol Edin

Eğer ekran kartınız destekliyorsa modelin bir kısmını GPU’ya aktararak performansı artırabilirsiniz. Ancak VRAM yetersizse sistem kararsız çalışabilir. Bu yüzden ayarları kademeli denemek daha doğru olur.

Yeni Başlayanlar İçin En Mantıklı Seçim Nedir?

LM Studio’ya yeni başlayan biri için genellikle Q4_K_M veya Q5_K_M modeller iyi bir başlangıçtır.

Düşük RAM’e sahip kullanıcılar:

Q4_K_M deneyebilir.

Orta seviye sisteme sahip kullanıcılar:

Q5_K_M daha dengeli olabilir.

Güçlü bilgisayara sahip kullanıcılar:

Q6 veya Q8 seçeneklerini deneyebilir.

Bu seçimler kesin kurallar değildir. Her modelin mimarisi, parametre sayısı ve sisteminizin donanımı sonucu etkileyebilir. Bu nedenle en iyi yöntem, birkaç farklı kuantizasyon seviyesini deneyerek kendi sisteminiz için en iyi dengeyi bulmaktır.

LM Studio’da Kuantizasyon Seçimi Neden Önemlidir?

Kuantizasyon seçimi, yapay zeka modelinden alacağınız deneyimi doğrudan etkiler. Yanlış model seçimi şu sorunlara yol açabilir:

- Model çok yavaş çalışabilir

- Bilgisayar donabilir

- RAM kullanımı aşırı artabilir

- Yanıt süresi uzayabilir

- Kalite beklentiniz karşılanmayabilir

Doğru kuantizasyon seçimi ise daha akıcı, hızlı ve verimli bir kullanım sağlar. Özellikle RAM dostu yapay zeka deneyimi isteyen kullanıcılar için bu konu oldukça önemlidir.

LM Studio Kullanırken En Sık Yapılan Hatalar

Çok Büyük Model İndirmek

Yeni başlayan kullanıcılar genellikle en büyük modelin en iyi sonuç vereceğini düşünür. Ancak büyük model, düşük donanımda çok yavaş çalışabilir. Bu da kullanıcı deneyimini olumsuz etkiler.

Kuantizasyon Seviyesini Dikkate Almamak

Aynı modelin farklı kuantizasyon sürümleri olabilir. Q4, Q5 ve Q8 arasında dosya boyutu, RAM kullanımı ve kalite açısından fark vardır. Bu nedenle sadece model adına değil, kuantizasyon seviyesine de bakmak gerekir.

Context Ayarını Gereksiz Yükseltmek

Çok yüksek context ayarı daha fazla bellek tüketir. Bu ayar, özellikle düşük RAM’e sahip sistemlerde performans sorunlarına neden olabilir.

Donanımı Göz Ardı Etmek

Her bilgisayar her modeli rahat çalıştıramaz. İşlemci, RAM, ekran kartı ve VRAM miktarı birlikte değerlendirilmelidir.

Kuantizasyon Güvenilir mi?

Kuantizasyon, yerel yapay zeka kullanımında oldukça yaygın bir yöntemdir. Ancak model küçültüldüğü için kalite kaybı yaşanabilir. Bu kayıp, seçilen kuantizasyon seviyesine ve modelin yapısına göre değişir.

Günlük sohbet, metin yazma, özetleme ve basit kod yardımı gibi işlemlerde Q4 veya Q5 modeller çoğu kullanıcı için yeterli olabilir. Daha teknik, uzun ve hassas görevlerde ise Q6, Q8 veya daha yüksek kaliteli seçenekler daha iyi sonuç verebilir.

Sonuç: LM Studio’da Kuantizasyon RAM Dostu Kullanımın Anahtarıdır

LM Studio’da model quantization yani kuantizasyon, büyük yapay zeka modellerini daha az RAM kullanarak çalıştırmayı sağlayan önemli bir tekniktir. Q4, Q5, Q6 ve Q8 gibi seçenekler; model boyutu, hız, bellek kullanımı ve cevap kalitesi arasında farklı dengeler sunar.

RAM dostu bir yapay zeka deneyimi istiyorsanız her zaman en büyük modeli seçmek yerine sisteminize uygun kuantizasyon seviyesini tercih etmelisiniz.

Genel olarak:

- Düşük RAM için Q4

- Dengeli kullanım için Q5_K_M

- Daha yüksek kalite için Q6

- Güçlü sistemler için Q8

daha mantıklı seçenekler olabilir.

Kısacası LM Studio’da doğru kuantizasyon seçimi, yerel yapay zeka deneyiminizi doğrudan etkiler. Hem RAM kullanımını azaltmak hem de daha akıcı yanıtlar almak için model indirirken kuantizasyon seviyesini mutlaka kontrol etmelisiniz.

Sıkça Sorulan Sorular

LM Studio’da quantization ne demek?

LM Studio’da quantization, yapay zeka modelinin daha az RAM ve disk alanı kullanacak şekilde sıkıştırılması anlamına gelir. Bu sayede büyük modeller daha düşük donanımlı bilgisayarlarda da çalıştırılabilir.

Q4_K_M iyi mi?

Q4_K_M, düşük ve orta seviye sistemler için iyi bir başlangıç seçeneğidir. RAM kullanımı düşüktür ve günlük kullanımda yeterli kalite sunabilir.

Q5_K_M mi Q4_K_M mi tercih edilmeli?

RAM’iniz azsa Q4_K_M daha uygundur. Daha iyi kalite istiyor ve sisteminiz yeterliyse Q5_K_M daha dengeli bir tercih olabilir.

Q8 model daha mı iyi?

Q8 modeller genellikle daha yüksek kalite sunabilir, ancak daha fazla RAM ve disk alanı kullanır. Güçlü sistemlerde tercih edilmesi daha mantıklıdır.

LM Studio için kaç GB RAM gerekir?

Bu, kullanmak istediğiniz modele göre değişir. Küçük ve kuantize modeller 8 GB RAM ile denenebilir. Daha rahat kullanım için 16 GB RAM, daha büyük modeller için ise 32 GB ve üzeri RAM önerilir.

Kuantizasyon modeli hızlandırır mı?

Kuantizasyon modelin daha az bellek kullanmasını sağlar. Bazı sistemlerde bu durum performansı olumlu etkileyebilir. Ancak hız; işlemci, ekran kartı, VRAM, RAM ve model boyutuna göre değişir.

En iyi LM Studio kuantizasyon seviyesi hangisi?

Tek bir en iyi seçenek yoktur. Düşük sistemlerde Q4, dengeli kullanımda Q5_K_M, güçlü sistemlerde ise Q6 veya Q8 daha iyi sonuç verebilir.